在之前的阶段中,我们学会了如何用最高阶的提示词去压榨模型的逻辑(Prompt Engineering),也学会了如何给大模型挂载外接私人 U 盘让它做开卷考试(RAG)。

当我们要去把一个冰冷的开源极客模型落地为一家专门服务于金融或医疗的商业 AI 项目时,极大概率会面临一个终极拷问:既然现在的开源基座都已经到了 GPT-4 的水准,我还有必要自己掏钱租机器搞训练(Fine-tuning)吗?

很多刚入行的开发者会陷入一个严重的认知误区:他们迷信原教旨主义,盲目觉得“微调出来的模型在任何方面都一定比只写写 Prompt 的强”。这会导致他们在一个只要改改措辞就能解决的问题上,白白烧掉几十万的服务器租金。

本章,我们将彻底讲透这三大兵器的适用边界。

1. 三大兵器的本质分野

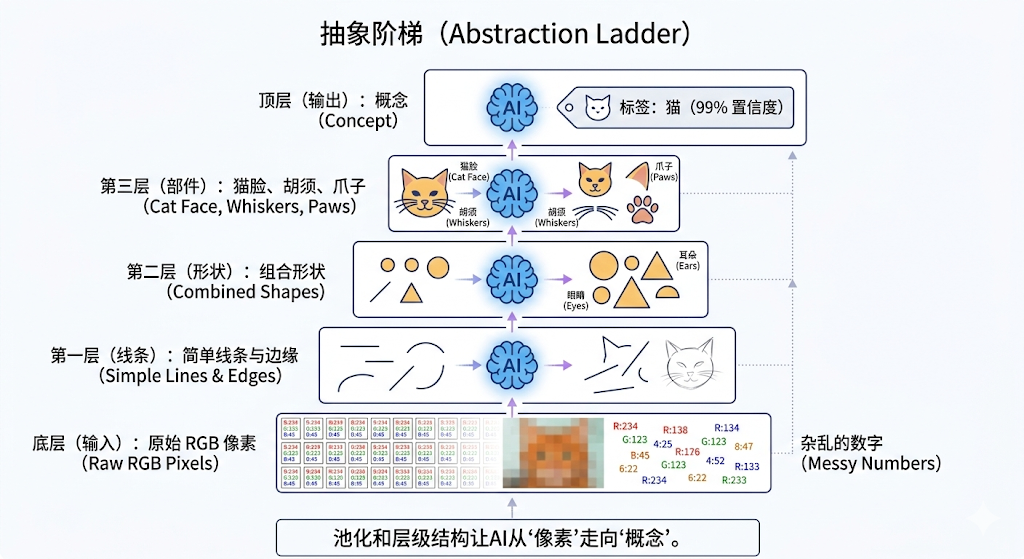

要真正搞懂该用什么,我们必须先认清它们在影响模型大脑时,介入层级的本质差异。

| 方法分类 | 技术本质 | 解决的核心命题 | 致命短板 | 形象化隐喻 |

|---|---|---|---|---|

| Prompt Engineering (提示词工程) | 短期记忆注入 | 教导模型如何理解当下任务格式以及框定角色边界。 | 上下文窗口限制极严,浪费算力 Token(每次发问都要把规则复述一遍)。 | 就像早晨给实习生写一张便签条,告诉他今天的具体目标是啥。 |

| RAG (检�索增强生成) | 外挂知识显存 | 给模型补充它从未见过的最新或私有物理数据。 | 模型本身依然是瞎子,它只是个尽职的图书管理员,如果文档里没写绝对推导不出。 | 就像给实习生发一本厚重的公司手册,让他不要凭空想,照着手册查。 |

| Fine-tuning (微调) | 永久肌肉记忆内化 | 彻彻底底在物理层面上拨动改变模型内部的权重参数,让其在出厂时就固化某种特定的技能、语气或绝对格式。 | 烧钱,数据清洗门槛极高,且一旦训练不当极易引发“灾难性遗忘”(学了新的忘了旧的)。 | 就像花重金送这个实习生去脱产进修一个月考取专职厨师证。 |

2. 究竟什么时候才真的需要微调(Fine-Tuning)?

在真实的商业落地中,微调绝对不是万能药。通常只有当你的业务卡死在以下四道坚硬的红线时,架构师才会不得已且谨慎地按下“点火微调”的按钮。

2.1 偏执的“格式与口吻”强迫症

这是微调最常见的发威场景。 假设你需要一个客服系统,要求模型在哪怕最极端的挑衅下,也绝不允许输出超过 30 个字,且每一句话结尾必须强行附上一段特定的 JSON 代码槽。如果你只用 Prompt 来防守,大模型只要稍有发散就会漏掉括号或者废话连篇。 但如果你给它喂了几万条严格按此种反人类格式标注的对话数据去进行微调,它底层的神经元权重就会被彻底物理扭曲。出炉后,它哪怕死机也不会再吐出一个多余的废话汉字。这就是 为了格式而微调。 同样,你想让它一开口就是绝对地道的“鲁迅风”或是“林黛玉调”,纯靠提示词只能得其形,只有依靠成千上万篇原文注入的微调,才能得其入髓的肌肉记忆神韵。

2.2 小模型上位:极致榨取推理成本

如果你要在本地的一台普通甚至由于保密协议断网的笔记本上,跑出一个能在专门看“心电图报告”上匹敌甚至超越 GPT-4 的助手,你绝不可能在本地塞得下那个千亿规模的怪兽。

唯一的破局之路就是模型蒸馏与微调: 你去租用强悍的 GPT-4 的 API,让它帮你生成几万份完美的“标准心电图问答数据”。然后你转头拿着这些珍贵黄金数据,去狠狠塞进一个体积只有 7B(几十亿参数)的开源“傻瓜”小模型里进行地狱级特训。 训练结束后,这头极小便宜的模型在“通用的琴棋书画”上依然弱智,但在且仅在“看心电图”这一个单一任务上,它直接拥有了匹敌天神 GPT-4 的肌肉反射直觉。你的单机推理成本瞬间暴降 99%。

2.3 RAG 也救不了的边缘暗语

有一类任务名叫深潜隐性知识。 如果你们公司的电报里充斥着“夜鹰计划要在 3 号井口汇合执行 P0 爆破”这种由完全无法在网上搜到的极深行话、首字母缩写以及毫无依据的黑话组成的暗语加密文档。 此时你如果用 RAG 去搜,原有的 Embedding 坐标系会当场错乱,因为在它的预训练世界观里,“夜鹰”就是一种纯粹的自然界鸟类,绝不等于某个绝密项目。 面对这种从底座世界观彻底颠覆的字典错位,只有拿微调的大锤去强行砸碎它原有的认知,把新概念从物理底层强行铸造进去。

3. 黄金法则总结

不要迷恋算法的繁复,在真实的商业沙场里请把这句话背下来: “能用 Prompt 花招绕过去的,绝对不要碰 RAG;能靠组合外挂 RAG 资料库搞定的,绝不要倾家荡产去启动炼丹炉微调。”

当然,一旦当你确信只有改造底盘参数才能突破业务瓶颈时,你就必须跨入那个深奥幽微、充满了玄学调参和硬件哀嚎的重工业区了。

下一章预告: 当决定要启动微调后,我们到底在训练什么?为什么现在你看到的那些开源大模型动辄就分为“Base 版本”和“Instruct 版本”? 欢迎来到打造大模型的兵工厂:6.2 炼丹炉纪元:从预训练到 SFT 指令微调。