"不是工作让人绝望,是上班让人绝望。" "上班"是沦为资本机器中的零件,受外部指令支配;而"工作"是拥有绝对自主权,是"自己那点事",基于天职与才干,伴随着创造的快乐。 ——陈丹青

如果用一个词来形容我的2025,那一定是重塑自我。 回想上一年的这个时候,我还在为未来感到迷茫。谁能想到,那台曾经被我认为是"过度投入"的台式机,现在竟然成了我最强的生产力工具,跑模型、做渲染,撑起了我的技术底座。这一年,我从迷�茫中杀出了一条血路,虽然跌跌撞撞,但也算是在这波涛汹涌的浪潮中站稳了脚跟。

"不是工作让人绝望,是上班让人绝望。" "上班"是沦为资本机器中的零件,受外部指令支配;而"工作"是拥有绝对自主权,是"自己那点事",基于天职与才干,伴随着创造的快乐。 ——陈丹青

如果用一个词来形容我的2025,那一定是重塑自我。 回想上一年的这个时候,我还在为未来感到迷茫。谁能想到,那台曾经被我认为是"过度投入"的台式机,现在竟然成了我最强的生产力工具,跑模型、做渲染,撑起了我的技术底座。这一年,我从迷�茫中杀出了一条血路,虽然跌跌撞撞,但也算是在这波涛汹涌的浪潮中站稳了脚跟。

这是整个 AI 学习之旅的起点。

在这一阶段,我们不整那些吓人的数学公式——线性代数、概率论、微积分这些可以在需要时查阅。

我们的目标是建立直觉,搞清楚一件事:为了让机器学会做一件事,工程师到底做了什么?

这个基础不打牢,后面每一章都会像空中楼阁。

我们要学的不是一种新的编程语言,而是一种全新的思考方式。

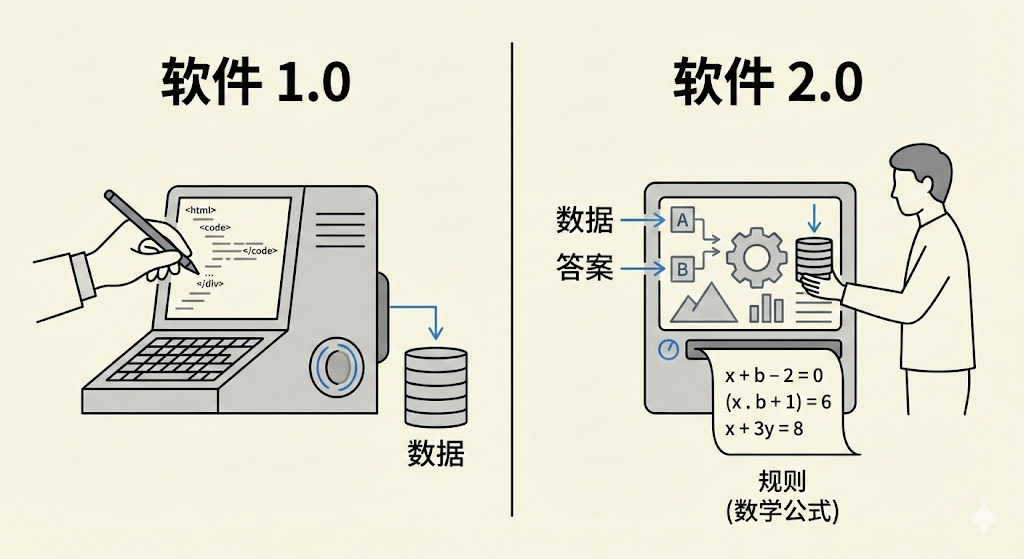

如果你是写业务代码的工程师,你每天做的事情大概是这样的:你告诉计算机每一条具体的规则。

如果你是�写业务代码的工程师,你每天做的事情大概是这样的:你告诉计算机每一条具体的规则。

if (有耳朵) and (有胡须) and (毛茸茸)...

既然规则太复杂写不出来,那能不能让机器自己把规则找出来?

我们不写规则了,给机器看一万张猫的照片和一万张不是猫的照片,然后告诉它:"你自己找规律,反正左边这些必须叫'猫',右边这些不行。"

机器经过一通计算,最后归纳出了一套超级复杂的数学公式(可能有一亿个参数)。这套公式,就是我们炼出来的模型(Model)。

这就是机器学习的核心:用数据换取规则。

和人类学习方式一样,机器学习也有三种范式。

这是最主流、应用最广的方法。

老师这回不给答案了,就把一堆数据扔给你:"你自己看看有什么规律。"

没有现成的数据集,而是通过互动来学习。本质是:没有标准答案,只有长期回报。

虽然我们承诺不堆砌吓人的公式,但知识图谱里的这几个数学名词,是你学 AI 必须建立的核心直觉。它们构成了机器能"学"懂一切的数理基石。

以后看论文、看文档,你会反复看到这几个词,先把它们映射到人话:

| 黑话(Term) | 人话映射 | 例子 |

|---|---|---|

| Dataset(数据集) | 教材库 | 一万张猫的照片 |

| Features(特征,X) | 题目的已知条件 | 照片的像素、房子的面积地段 |

| Labels(标签,y) | 标准答案 | "这是一只猫"、"房价 500 万" |

| Model(模型) | 负责做题的脑子 | 一个巨大的数学函数 |

| Parameters(权重/参数) | 脑子里的神经连接强弱 | 训练出来的"规则"本身 |

| Training(训练) | 刷题的过程 | 调整参数,让正确率越来越高 |

| Inference(推理) | 考试 | 训练结束,拿新题让模型输出答案 |

| Evaluation(评估) | 判卷老师 | 衡量模型在真实场景下是否有用 |

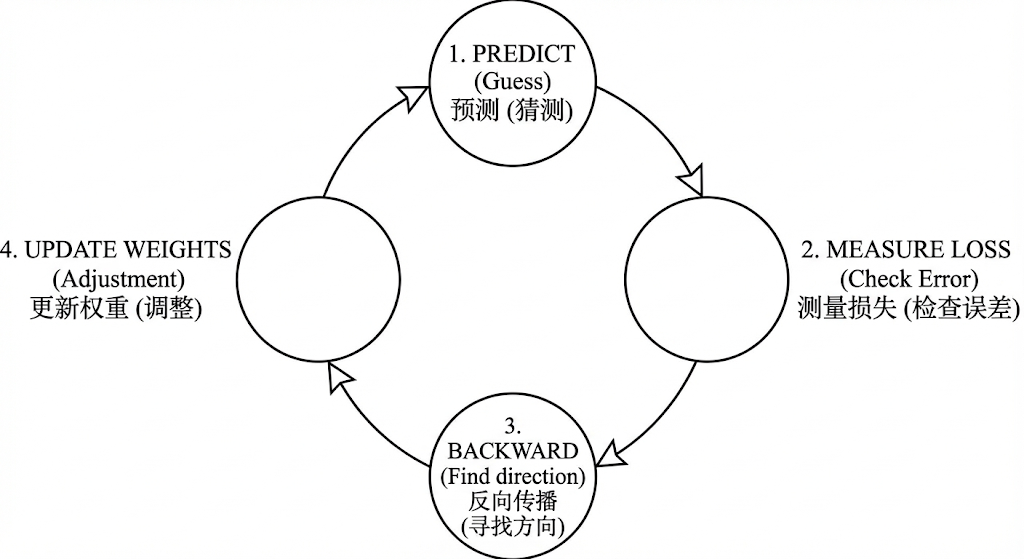

这是本章最重要的部分。所谓"训练模型",其实就是在跑一个死循环。

想象一个蒙着眼睛的人摸着下山:

第一步:猜(Forward Pass / 前向传播) 模型拿到一道题,先根据当前参数瞎猜一个答案。

模型:我觉得这是猫!

第二步:对答案(Loss Function / 损失函数) 用损失函数来衡量猜得有多离谱。Loss 越高表示错得越离谱。

裁判:错!这是狗。你的答案离正确答案差了十万八千里(Loss = 1000)。

第三步:找方向(Gradient / 梯度) 计算出要往哪个方向调参数,才能让 Loss 变小。就把梯度理解成"坡度"——指出下山的方向。

模型�:那我该往哪个方向改?是把参数调大点还是调小点?

第四步:改错(Optimizer / 优化器) 用优化器按照梯度方向,微调模型里的参数。

优化器:刚才那个参数调小一点点,下次应该能对。

这个循环跑几百万次,直到 Loss 几乎变成 0,我们就说:训练完成了。

Loss 越低 = 模型越好?不对。

过拟合(Overfitting):模型在训练集上 Loss 极低,但在新数据上一塌糊涂。 就像一个学生把历年真题答案全背下来了,但换一道新题就不会了。

这也是为什么我们要把数据分成三份:

永远不要用测试集来做任何决策(比如选模型、调超参数),否则测试集就变成了"另一个训练集",你的评估结果就没有意义了。

有了这个“黑箱循环框架”,这就足够了。 关于具体的 损失函数(交叉熵/MSE) 和 优化器(SGD/AdamW等) 有哪些分类,这属于构建具体模型时的底层黑科技,我们将在下一阶段详细解答。

下一章预告: 现在我们知道了机器是怎么"学"的——但如果问题复杂到了“识别图片是一只猫”、或者“理解一段长语言”?仅仅靠简单的线性数学公式绝对搞不定。

这就需要一个层级庞大、能画出任意弯曲边界的超级"脑子"——欢迎进入第1阶段:深度学习核心。 我们将在这个阶段,把神经网络这个黑箱扒开,看看人工神经元和链式法则的真面目。

下一章: 1.1 神经网络骨架(MLP与反向传播)

一张 AI 工程学习路线图,按学习顺序排列。你可以把它理解为"课程大纲"——在开始每个阶段之前,先来这里扫一眼该阶段的关键词,学完之后再回来,看看掌握了多少。

每个技术点都有优先级标注,含义如下:

| 标记 | 含义 | 行动建议 |

|---|---|---|

| 🔥 P0 | 必须掌握 | 现在就学,绕不过去 |

| ⭐ P1 | 需要理解 | 按需学,遇到了再深入 |

| 📚 P2 | 了解即可 | 知道这东西存在就够了 |

本图谱默认你已经具备:

如果这些还不会,先去补,本图谱不展开。

第0阶段 → 第1阶段 → 第2阶段 → 第3阶段 → 第4阶段 → 第5阶段

数学基础 深度学习 Transformer 提示工程 RAG Agent

↓

第6阶段 第7阶段

← ← ← 微调 部署优化

第8阶段 第9阶段 第10阶段

多模态 评估安全 商业生态 ← 可与第3-5阶段并行学习

建议路径:0 → 1 → 2 → 3 → 4 → 5,这是核心主线。

第6-7阶段(微调/部署)和第8-10阶段可以按需跳入。

🎯 目标:建立直觉,不是变成数学家。够用就行。

🎯 目标:理解神经网络是怎么"学"的,知道每个组件在干什么。

🎯 目标:理解现代 AI 的"发动机"——Transformer,以及 GPT/BERT 是怎么建在它上面的。

🎯 目标:用好 API——不写一行训练代码,只靠 Prompt 就能解决 80% 的问题。

🎯 目标:解决"AI 不知道你公司的事"——把私有知识库接入 LLM。

🎯 目标:从"聊天机器人"升级到"能干活的 AI"——让模型自主规划和执行任务。

🎯 目标:当 Prompt + RAG 都不够用时,直接改变模型本身的能力。

🎯 目标:让模型跑得更快、更便宜、更稳——从本地到生产环境。

🔗 对应文章:模型优化与部署

🎯 目标:了解 AI 能力的边界——图像、语音、推理,以及现在最热的进展。

🎯 目标:AI 项目最容易翻车的地方——上线前后都要考虑。

🎯 目标:了解市场上有什么,做选型决策时不瞎选。

颜色说明:

- 灰色 = 理论基础(按需查询)

- 粉色 = 应用核心(先学这里)

- 蓝色 = 工程深化(有需求再学)

- 绿色 = 生态认知(随时了解)

学 AI 最大的坑是贪多求全。

这份图谱不是让你从第 0 阶段到第 10 阶段全部学完,而是:

开始行动:直接从第3阶段 Prompt Engineering 开始,做一个能用的 Demo,再往后走。

[!NOTE] Q: 为什么要设置虚拟环境 A: 首先,它防止版本冲突。它将每个代理的依赖项隔离开来,确保一个代理的更新不会意外地破坏另一个工具或系统。

cd path\to\your\project

python -m venv agent-env

agent-env\scriptslactivate

pip install dependencies

pip freeze > requirements.txt

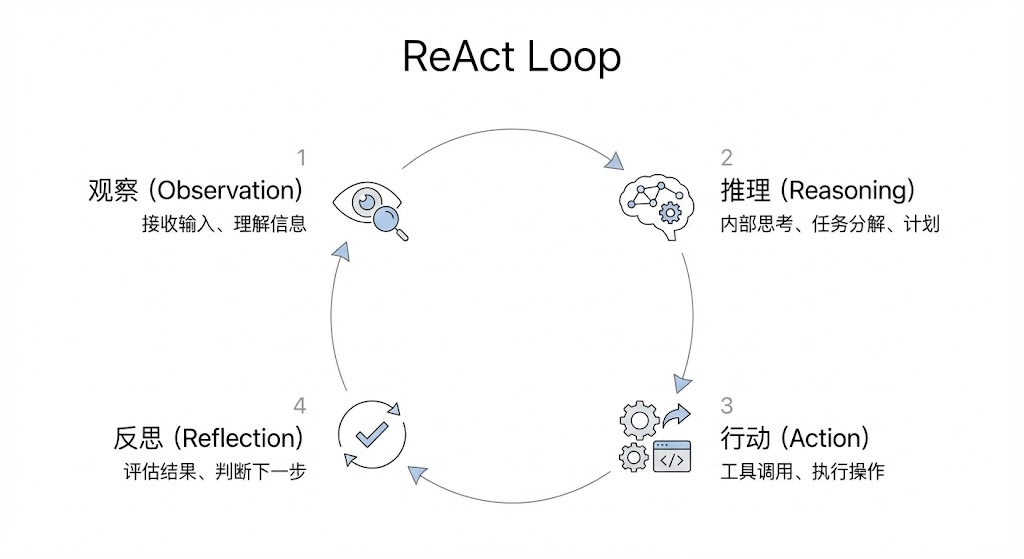

在自主 AI 开发中,ReAct 循环扮演着同样的角色。它为 AI 系统提供了一种结构化的方式来思考任务、选择合适的工具并智能地行动。ReAct 将模型转变为一个由迭代思考和行动驱动的解决问题代理,而不是简单地用文本回应的聊天机器人。

ReAct,全称 Reasoning + Acting,是现代自主系统的核心。它将逻辑推理与工具执行相结合,使 AI 能够像人类助手一样处理任务。其核心优势包括:

这个过程始于代理接收到输入,类似于实验室助理接到任务。代

输入接收:

观察信息:

设定上下文:

在采取任何行动之前,代理会进行内部推理。它可能会将任务分解为步骤,考虑哪个工具最合适,或分析它已经掌握的信息。推理是代理的"计划时刻",确保行动是有意而非冲动的。这就像助理决定是查找数据、运行实验还是请求澄清后再继续进行。

一旦代理有了计划,它通常通过调用函数或外部工具来采取行动。这可能是一个搜索查询、API 调用、计算或内存查找。在代理框架中,这些行动通常表示为结构化的 JSON 命令,告诉系统使用哪个工具以及传递什么参数。就像实验室助理根据他们的推理执行特定任务一样,代理精确地执行函数,并且是确定性的。

行动之后,代理评估结果。工具是否返回了所需信息?问题是否解决,还是需要其他步骤?这种反思反映了人类助手在继续之前检查实验是否成功或查询是否提供了正确数据的过程。反思可以防止无限循环,并帮助助�手与目标保持一致。

代理会持续循环观察 → 推理 → 行动 → 反思,直到得出最终答案。在实践中,这可能涉及多次工具调用、多轮推理,或记忆查询与计算的组合。就像研究人员不断迭代直到找到解决方案一样,ReAct 循环使 AI 助手能够处理跨越多步骤的任务。